| | | | | | | | | | | | << | 5月 | >> | | 日 | 月 | 火 | 水 | 木 | 金 | 土 | | . | . | . | . | . | 1 | 2 | | 3 | 4 | 5 | 6 | 7 | 8 | 9 | | 10 | 11 | 12 | 13 | 14 | 15 | 16 | | 17 | 18 | 19 | 20 | 21 | 22 | 23 | | 24 | 25 | 26 | 27 | 28 | 29 | 30 | | 31 | ・ | ・ | ・ | ・ | ・ | ・ |

| |

| |

| |

| | | | | | | | | | | | | | | | | 2026/03/24 19:00:30 プライベート♪ | | | IT | | | AI.便利な面とそうでない面 | |

| |

| | |

以前は調べたいことは検索をかけて、その中から個人や企業が投稿しているページで自分が探している項目に近いものを検索に上がっている上位の項目から下に向かって探して見つけるという作業を行っていた。

従って幾分個人の考えで認められているものが上位にくると推定して取り上げていた。

ところがこの数年、検索を掛けると上位というか最初にAIによる答えのようなものが表示されるようになって来た。問題解決できるという点では参考にしたいもの。

Wikipediaも結構利用して来たが、一時人の履歴が(特に学歴など)以前とまるで変わり思い込みで誰かによって書き換えられていると感じ、この部分は今でも信用できない部分となっている。

本人が書くわけでないことは分かるが、では一般人ならこれができるのかという疑問もあった。

調べるとAI による概要では、その通りです。Wikipediaの人物の履歴やプロフィールなどの内容は、原則として一般人(無報酬のボランティア)によって書き換え・編集されています。と出る。

具体的には以下のような仕組みで運営されているそうな。

・誰でも編集可能: アカウントの有無に関わらず、インターネット環境があれば誰でもページの閲覧、作成、修正が可能です。

・ボランティアによる編集: 「ウィキペディアン」と呼ばれる、世界中のボランティアが知識を共有し、日々情報を更新・修正しています。

・内容の修正: 間違いを見つけた人や、新しい情報を知っている人が自由に内容を書き換えることで、情報の精度を維持しています。

一方で、以下のような例外的なケースも存在します。

・本人や関係者による編集: 本人や所属事務所のPR担当者が、自身のページを編集するケースも明らかになっています。

・荒らしや宣伝活動: 一般人といっても、悪意のある変更や宣伝目的の書き込みが行われることもあり、それらは他のボランティアによって修正・監視されています。

これらのことは政治家などこのページでどういう人かあたりをつけて判断していたものが、プロパガンダや政治家にしたいがために箔をつけたいという野望も見え隠れし実態は掴めないことになる。世界的に有名なページでこんなことがあっていいのか。従って別の判断材料も必要になる。

-------------------------------------------------------------------------

検索ではあまり長い文章を打ち込むのも遠慮していたが、案の定文字数制限があるらしい。

1. 検索語句の文字数・語数制限

・最大語数: 一度の検索で入力できるキーワードの数は32語(32ワード)まで緩和されています。

・日本語: 単語や文章を最大32語まで入力可能。

英語: 英語でも32ワードまで入力可能です。

注意点: 通常の検索では32語を超える入力は無視されるか、制限されます。

しかし試しに100文字以上打ち込んで尋ねたらきちんと答えてくれたので一応ということになっているのだろう。

問題解決の手段としては全信頼を置いている訳ではないが、話し相手のように一応は答えてくれる。時にはいい質問ですねのような同調姿勢も見せてくれる。よってGoogle検索でも有料のチャットGPTを使わなくてもある程度は済まされる。

--------------------------------------------------------------------------

AIは政府や大統領によっても利用され、これによって政治経済が進められるのかという疑問もある。経済体制も自由主義体制だけとは限らず一律に判断できないはず。

各国の国の事情や宗教、又、政府と国民は意見が一致しているとは限らず相違が見られるはずだし、国民性によっても変わって来る。

トランプがAIに問い合わせてそれでもって世界各国に万能と思わせてこのはずだと強制してもそれは違う。

聞き方が悪いのかAIに聞いても回答が返って来ないこともしばしばある。

イランの最高指導者アリ・ハメネイ師がイスラエルとアメリカのモサドやCIAによって暗殺された。

AIが国や政府に共有されて、反発する国に対してテロ反撃行為に利用される可能性も否定できない。

例えばインフラや放火、山火事に対して証拠の残らない方法を探して実行するということも考えられる。気象兵器や暗殺もしかり。

もし殆どの国がアメリカの行動に反対しロシアの側につくとアメリカは世界の国々を相手に攻撃を始めるのかどうなのか。

---------------------------------------------------------------------------

AI検索で便利なところ(google)

AI検索の便利な点は以下の通り。

1. 時間短縮 : AIが複数のサイトから情報を集約・要約し、直接回答を提供するため、調べ物にかかる手間が大幅に減ります。

2. 自然な質問 : キーワードを考える必要がなく、会話形式で質問でき、文脈を理解して追加質問にも対応します。

3. 信頼性の確認 : 回答の出典を示すことで、情報の信頼性を簡単に確認できます。

4. 簡単な比較やリサーチ : 複雑な情報を瞬時に比較・まとめることができ、特化型ツールを使えば資料作成も行えます。

5. 画像や多言語対応 : 写真から情報を検索できる機能や、多言語での情報収集と日本語要約が可能です。

--------------------------------------------------------------------------

代表的なAI検索サービス:

・Perplexity (パープレキシティ): リサーチに特化した信頼性の高い回答。

・Felo (フェロー): 日本発、多言語の検索と整理・資料作成が強み。

・ChatGPT (SearchGPT): 自然な会話形式で、対話的に検索。

・Google AIモード (AI Overview): 従来のGoogle検索でAIの要約機能が使える。

・Microsoft Copilot: Microsoft製品との連携が強み。

--------------------------------------------------------------------------

検索ポータルサイトは約12ほどある模様だけれど、AI検索で優れているのは

2026年時点の検索ポータルサイト・検索エンジンにおいて、AI検索機能が優れている代表的なサービスは以下の通り。

1. Google (AI Overview / AIモード)

特徴: 世界シェア1位の検索エンジン。AIが情報を統合・要約し、回答を生成する「AI Overview(旧SGE)」が標準的に組み込まれています。

強み: 膨大なWebデータに基づいた包括的な回答力と、信頼性の高さ。

2. Microsoft Bing (Copilot in Bing)

特徴: MicrosoftのAI「Copilot」を統合。対話型で最新情報を検索できる。

強み: 検索結果にAIの回答が直接表示され、引用元が明記されるため信頼しやすい。Microsoft Edgeブラウザとの連携も強力。

3. Perplexity (パープレキシティ)

特徴: AI検索に特化した新しいタイプのエンジン。自然な質問に対し、即座に要約と出典を提示する。

強み: 回答の正確性が高く、根拠となる情報源が明確に示されるため、リサーチ業務に最適。

4. Felo (フェロー)

特徴: 日本発の生成AI検索ツール。日本語の自然言語処理に特化している。

強み: SNSやニュースから最新のトレンドを抽出し、検索から整理、資料作成までまとめて対応できる。

5. Brave (Brave Leo)

特徴: プライバシー重視の検索ブラウザ「Brave」に搭載されたAIアシスタント「Leo」。

強み: 匿名性が高く、ユーザーのデータを収集せずに高速なAI回答を得られる。

--------------------------------------------------------------------------

AI検索でデメリットとされるのはどういう点か

AI検索(生成AIを活用した検索エンジンやAIチャットボット)のデメリットとして、主に以下の点が挙げられます。

1. 情報の正確性と信頼性の問題 (ハルシネーション)

・誤情報の提示(ハルシネーション): AIはもっともらしい嘘(誤った情報)を生成することがあります。

・信頼性の保証がない: 学習データに基づいて情報を生成するため、情報の偏りや不正確な内容が含まれるリスクがあります。

・最新性のタイムラグ: AIの学習データがリアルタイムの最新情報に完全に追いついていない場合があります。

2. セキュリティとプライバシーのリスク

・情報漏えいの危険性: AIに入力した情報が学習データとして利用され、他のユーザーとの対話の中で漏えいする可能性があります。

・プライバシー侵害: 検索履歴や入力データがAIモデルの改善に利用されることで、個人情報が流出するリスクがあります。

3. 情報の偏りと著作権の問題

・バイアス(偏見): 学習データに含まれる偏見や特定の視点に偏った回答が表示されることがあります。

・著作権侵害: 生成されたコンテンツが他者の知的財産権を侵害している可能性があります。

4. ユーザー体験とWebエコシステムへの影響

・Webサイトへのアクセス減少: AIが検索結果を要約して回答を完結させるため、ユーザーが元のWebサイトを訪問しなくなり、Web運営者のトラフィックが減少します。

・情報のブラックボックス化: AIがどのような根拠でその回答を導き出したのか、思考プロセスが不明確な場合があります。

5. 心理的・能力的な影響

・AI疲労: 検索のたびに適切なプロンプト(指示)を入力したり、回答を検証したりする必要があり、これが長期化すると精神的疲労につながるという指摘があります。

・回答の淡白さ: 人間の感情や複雑なニュアンスを理解するのが苦手で、回答が機械的・冷淡に感じられることがあります。

これらのデメリットは、AIをツールとして正しく理解し、信頼できるソースで情報検証(ファクトチェック)を行うことで軽減できます。

--------------------------------------------------------------------------

アメリカの大統領もAIに問い合わせているフシが見られるが、スパイ行動に利用すると、軍事や世界の平和に少なからぬ悪影響を与えかねないかという懸念があるが・

現状の主な動向とリスクは以下の通りです。

1. 軍事・スパイ目的でのAI利用の現状

米軍のAI利用: アメリカ国防総省はAIを「現代の戦場において不可欠な技術基盤」と位置づけ、Anthropic(アンソロピック)の「Claude」などの生成AIを機密システム内で利用する契約を締結しています。

情報収集(スパイ)への転用: NSA(国家安全保障局)が安全保障目的だけでなく、産業スパイ活動にもAIやサイバー能力を活用しているという証言があり、情報収集が強化されていると見られています。

自律兵器(AI兵器)への懸念: 国防総省はAI技術の軍事利用拡大を求めていますが、AIが人間を介さず敵を攻撃する「自律型兵器」や、国民の「大規模監視」に繋がるとの懸念から、AI企業が制限を求めて米政府と衝突するケースも発生しています。

2. 軍事と世界平和への悪影響・懸念

判断の自動化リスク: 人間ではなくAIが生命に関わる決定を行うことへの倫理的・安全上のリスクが指摘されており、誤った判断が軍事的衝突を招く恐れがあります。

国際的な規制の拒否: AI軍事利用の国際的な規制議論に対し、米国は「完全拒否」の姿勢を示しており、軍拡競争の引き金になる懸念があります。

セキュリティと監視: AIを使ったサイバー攻撃は、他国へのサイバー空間でのスパイ活動を容易にし、市民社会や国際関係に甚大な被害を与えるリスクがあります。

意思決定の歪み: AIが導き出した不正確な情報や偏った分析に基づいて指導者が判断を下すことで、予測不可能な事態を招く恐れがあると指摘されています。

アメリカ大統領や国防総省がAIに情報収集を任せる姿勢は、セキュリティ強化の側面がある一方で、国際的な紛争リスクを増大させる両刃の剣であると言えます。

--------------------------------------------------------------------------

核よりも強い有望な兵器が開発される可能性は

はい、核兵器よりも強力な潜在的威力を持つ

理論上の兵器や、異なる形で甚大な影響を及ぼす新たな種類の兵器が開発される可能性は存在します。

理論上のより強力な兵器

・反物質兵器: 理論上、反物質と物質が衝突すると、現在の核兵器(核分裂や核融合)よりも効率的にエネルギーが放出されるため、同じ質量であれば核兵器よりはるかに強力な兵器となり得ます。ただし、現時点では反物質を大量に生成・貯蔵する技術は確立されていません。

・純粋核融合兵器(非核起爆): 現在の水素爆弾は原子爆弾(核分裂)を起爆剤として使用していますが、もし核分裂反応を伴わずに純粋な核融合反応のみで爆発を起こせる技術が開発されれば、より強力な兵器となる可能性があります。

影響力の点で核兵器を凌駕する可能性のある新兵器

「強力」の定義を破壊力だけでなく、戦争のあり方を変える影響力や制御不能な危険性も含める場合、以下のような技術が挙げられます。

・AI兵器: 人間の関与なしにAIが攻撃の判断を下す兵器システムは、その自律性と予測不可能性から、核兵器を超える脅威となる可能性が議論されています。

・ナノ兵器: 自己増殖するナノマシンが制御不能になった場合、環境や生態系に壊滅的な打撃を与える可能性が指摘されていますが、その開発状況は軍事機密でありベールに包まれています。

・極超音速ミサイルと長距離兵器: ロシアの新型核搭載可能ミサイル「ブレヴェスニク」(NATOコードネーム「スカイフォール」)のように、ほぼ無限の航続距離と予測不能な飛行経路を持つ兵器は、既存の防衛システムでは迎撃困難であり、戦略的な影響力が極めて大きいと考えられています。

・サイバー兵器: 国家のインフラ(電力網、通信網、金融システムなど)を麻痺させるサイバー攻撃は、物理的な破壊を伴わずに社会機能を停止させることが可能であり、その影響は広範囲かつ甚大になる可能性があります。

------------------------------------------------------------------------

検索については人が監視していることはあるのか

AI による概要

検索エンジンやインターネットの利用において、

人がリアルタイムで一人ひとりの検索内容を監視している可能性は非常に低いですが、データとして記録・分析されており、特定の状況下では人の目に触れる可能性や、組織によってモニタリングされているケースがあります。

具体的な状況は以下の通りです。

1. 組織によるモニタリング(職場・学校)

・社内Wi-Fiや会社PC: 会社の通信環境(Wi-Fi)を使用している場合、システム管理者が誰がどのサイトを見て、何を検索したかのログを確認できる場合があります。

・メール・チャット: 会社のアカウントを利用している場合、通信内容は会社の資産とみなされ、閲覧される可能性があります。

2. データ分析とAIによる自動監視

・機械による自動追跡: Googleなどの検索エンジンは、ユーザーの興味や行動を分析するために検索クエリ(検索ワード)を自動的に記録・収集しています。

・パーソナライズ: 収集されたデータは、個人の好みに合わせた広告表示や、検索結果のカスタマイズに使われます。

3. 法執行機関による監視

・通信傍受: 国家安全保障局(NSA)のような機関が、テロ対策や捜査目的でインターネット上の通信を傍受し、監視している実態が過去に告発されています。

4. 誰かにバレる可能性があるケース

・端末の共有: 家族や友人と共有しているPCやスマホで、自動入力機能や閲覧履歴から検索内容がバレることがあります。

・アカウントの同期: スマホとパソコンで同じGoogleアカウントを使っている場合、片方で検索した内容がもう片方にも表示されます。

監視を防ぐための対策

・シークレットモード(プライベートブラウジング)の利用: 検索履歴やブラウザの履歴を残さない設定です。

・検索履歴の削除: Googleアカウントの「マイ アクティビティ」から履歴を削除できます。

・会社の端末では私的な検索をしない: 会社のデバイスで個人の検索を行うことは避けましょう。

検索という行為自体はプライベートなものですが、ネットに接続している限り、データとして残るため、完全に秘密にしたい内容は注意が必要です。

---------------------------------------------------------------------------

AIは日本人が開発したわけでもないが、一旦作ってしまうと、あとはデータを入れてゆくだけで目的が果たせるか

AI(人工知能)の開発はアメリカなどの海外企業が主導している側面はありますが、一度構築された基盤モデル(基礎となるAI)に、目的特化したデータを追加で学習(ファインチューニング)させることで、特定の目的を果たすことは可能です

。

しかし、「データを入れれば自動的に目的が達成される」ほど単純ではありません。 実用的な目的を果たすためには、継続的なメンテナンスや適切な運用が必要です。

現状、AIの活用において必要な要素は以下の通りです。

1. データだけで目的を達成できること(利点)

・汎用モデルの活用: GPT-4やGeminiなどの大規模言語モデル(LLM)は、基礎能力が高い。

・再学習・調整: 日本語データや専門データを追加学習することで、日本文化や特定のビジネス業務に適応したAIを作成できる。

2. データだけでは達成できない要素(課題)

・データの「質」と「選別」: 単に大量のデータを入れるだけでは不十分で、正確で偏りのない高品質なデータが必要。

・目的・倫理の定義: AIは目的がなければ、何をすべきか判断できない。人間が実現したいこと、倫理的判断や目的を明確にする必要がある。

・AIの限界(人間による判断): AIは過去のデータを学習するため、未経験の事象や、創造性・複雑な感情理解が必要な場面では、人間が最終的な判断を下す必要がある。

結論として、基礎開発は海外が主導しているものの、日本国内で蓄積された独自のデータを活用することで、高性能な「国産AI」や専門AIを作り、目的を達成することは可能である。

---------------------------------------------------------------------------

生成AI画像や映像のデメリットや懸念点

生成AI画像や映像技術の急速な発展は、コンテンツ制作を劇的に効率化する一方、倫理的、法的な観点から多くの重大なデメリットや懸念点が指摘されている。主なリスクは以下の通り。

1. 著作権・権利侵害のリスク

・著作権侵害: AIの学習データに既存の著作物が無断で使用されているケースが多く、出力された画像や映像が既存作品と類似してしまう(類似性・依拠性)ことで、著作権侵害の訴訟リスクが生じます。

・肖像権・パブリシティ権の侵害: 実在の有名人や個人の顔、特徴を模倣した画像・映像(ディープフェイク)が生成され、本人の権利を侵害する恐れがあります。

AI による概要

生成AI画像や映像技術の急速な発展は、コンテンツ制作を劇的に効率化する一方、倫理的、法的な観点から多くの重大なデメリットや懸念点が指摘されています。主なリスクは以下の通りです。

1. 著作権・権利侵害のリスク

・著作権侵害: AIの学習データに既存の著作物が無断で使用されているケースが多く、出力された画像や映像が既存作品と類似してしまう(類似性・依拠性)ことで、著作権侵害の訴訟リスクが生じます。

・肖像権・パブリシティ権の侵害: 実在の有名人や個人の顔、特徴を模倣した画像・映像(ディープフェイク)が生成され、本人の権利を侵害する恐れがあります。

2. 倫理的・社会的リスク

・フェイクコンテンツ(ディープフェイク)の拡散: 高精細な偽の映像や画像が容易に作成できるため、デマやフェイクニュースの拡散、政治的混乱を招くリスクがあります。

・偏ったデータと差別的表現: 学習データに含まれる人種、性別、年齢などの偏り(バイアス)により、差別的・ステレオタイプ的な画像や映像が出力されるケースがあります。

・犯罪への悪用: 性的な画像や、本人の同意のないディープフェイク動画などの有害コンテンツ制作に悪用される事例が報告されています。

3. セキュリティ・情報漏洩

・機密情報の漏洩: 入力したプロンプト(指示文)や画像データがAIモデルの学習に利用され、外部に流出してしまうリスクがあります。企業が社内資料や顧客情報を入力する際に特に注意が必要です。

4. クオリティと信頼性の問題

・ハルシネーション(誤った情報): AIが実在しない情報を真実のように生成するリスクがあり、ニュースや教育的な画像・映像において誤解を与える可能性があります。

・品質のばらつき: 高品質な出力を得るためには適切なプロンプト指示が必要であり、常に期待通りの結果が得られるとは限りません。

5. 職業・創造性への影響

・イラストレーターや映像クリエイターの雇用減少: AIが高品質なコンテンツを短時間で安価に生成できるため、人間のクリエイターの仕事が奪われる可能性が懸念されています。

・人間の創造性の低下: AIに依存しすぎることで、自ら考える力やクリエイティビティが低下する可能性が指摘されています。

これらの技術を活用する際には、著作権法や利用規約を正しく理解し、機密情報の取り扱いに十分注意を払う必要があります。

--------------------------------------------------------------------------

人を含むほぼ全ての映像がAIで作られている世の中になったら、どんな詐欺やマインドコントロールもできてしまう。

そしてAIか実映像か判別できなくなったらその判別に時間ばかり割きまさに恐怖。

これも作りものか〜で将来的に分かれる確率は何:何か?

実際に見ないと気が済まない人たちは、例えばAIで作られた動画を見て、特殊詐欺の主催者がもし旅行運賃を支払えばそこへ連れて行ってあげると募集したら、あっさり引っかかるだろうか?

https://www.youtube.com/shorts/4uZeH_8HshE

あと一歩の受け狙いの為にそこまでAIを活用したいのか?

--------------------------------------------------------------------------

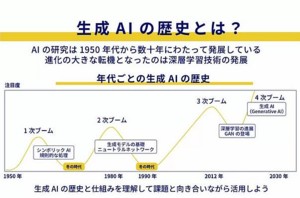

生成AIの歴史|誕生から今後の課題まで

https://site.xaris.ai/blog/544/ 2025年3月3日

| | |

| |

| |

|

|